本文撰写之时,实际应用中最有效的序列模型称为门控RNN。 包括基于长短期记忆和基于门控循环单元的网络。

像渗漏单元一样,门控RNN想法也是基于生成通过时间的路径,其中导数既不消失也不发生爆炸。 渗漏单元通过手动选择常量的连接权重或参数化的连接权重来达到这一目的。 门控RNN将其推广为在每个时间步都可能改变的连接权重。

[success]

手动选择或参数化w -> 每个时间步改变w

问:参数化w和每个时间步改变w,其w都是不确定的,有什么区别?

答:参数化w,虽然w在一开始不知道,但是会通过训练找到最好的w。最好的w一但确定了,在预测时就会一直使用这个w,不会再改变了。

渗漏单元允许网络在较长持续时间内\emph{积累}信息(诸如用于特定特征或类的线索)。 然而,一旦该信息被使用,让神经网络\emph{遗忘}旧的状态可能是有用的。 例如,如果一个序列是由子序列组成,我们希望渗漏单元能在各子序列内积累线索,我们需要将状态设置为0以忘记旧状态的机制。 我们希望神经网络学会决定何时清除状态,而不是手动决定。 这就是门控RNN要做的事。

[success]

门控RNN的特点:

(1)长时间积累信息

(2)必要时遗忘旧的状态

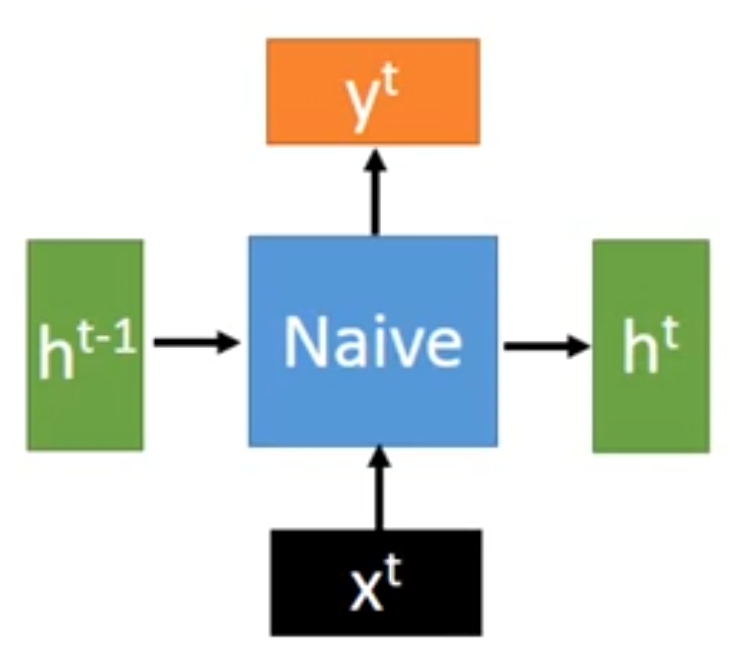

普通Unit

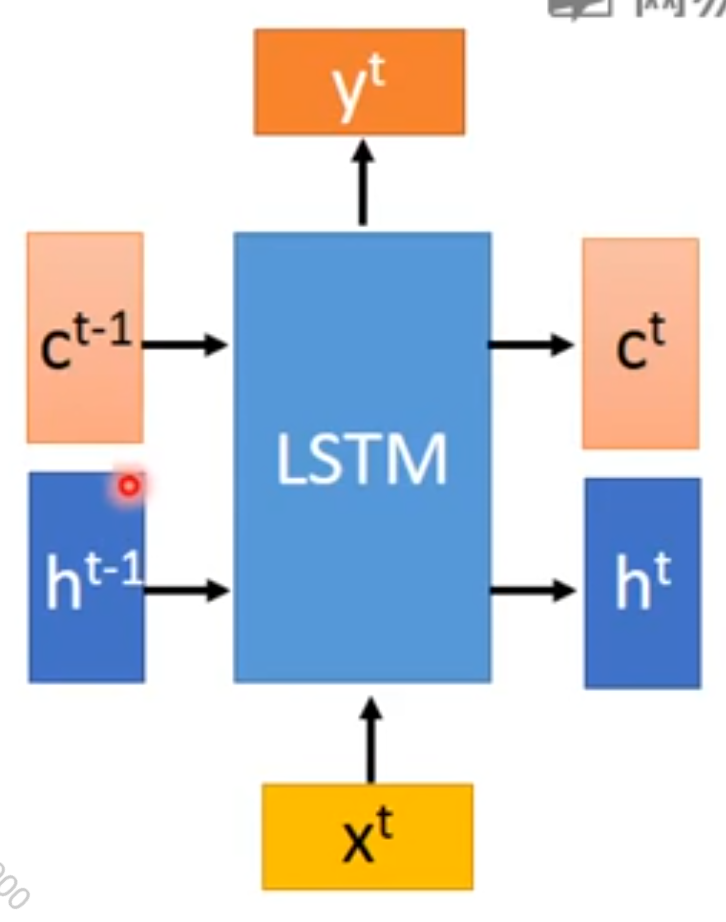

LSTM

is added by something ---> C变化慢

h^t和h^{t-1}可以完全不一样 ---> h变化快

C代表memory Cell